음향:digital:pcm:start

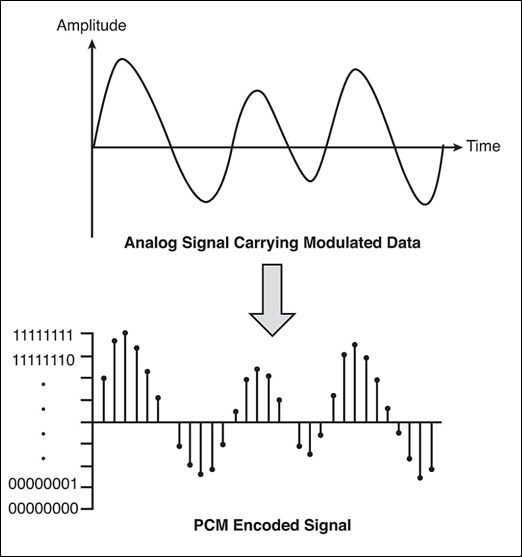

PCM

Pulse Code modulation, LPCM(Linear PCM)

오디오 신호를 디지털 데이터(2진수)로 변환하는 가장 기본적인 표준 방식

PCM은 무압축 원본 디지털 오디오 형식으로, CD(44.1kHz/16bit), 스튜디오 마스터(96kHz/24bit), 전문 녹음(192kHz/32bit) 등 모든 디지털 오디오의 기반입니다.

PCM의 핵심 특징

실제 응용(PCM 포맷들)

로그인하면 댓글을 남길 수 있습니다.

[공지]회원 가입 방법

[공지]글 작성 및 수정 방법

음향/digital/pcm/start.txt · 마지막으로 수정됨: 저자 정승환